Intelligence Artificielle : le côté obscur de la force

Plagiat, mort de l’esprit critique, paresse intellectuelle… Telles sont les dérives de la démocratisation de l’IA via les plateformes d’IA générative (Chat GPT), d’IA basée sur du langage factuel (Bard de Google), d’IA de création d’image et de toutes les applications dérivées.

Les IA génératives (ChatGPT) ainsi que les IA factuelles (Bard de Google) sont des technologies de pointe qui utilisent des algorithmes particulièrement complexes pour simuler la compréhension et la génération de langage humain. Ils peuvent créer du contenu, résoudre des problèmes et donner des infos sur de très nombreux sujets.

C’est très bien que ces outils se démocratisent.

Certains sont gagnants : ces outils peuvent permettre de gagner énormément de temps en résumant un texte ou une vidéo, en indiquant comment corriger une ligne de code…

D’autres sont à risque : certains graphistes, des services de traduction, des rédacteurs freelance offshore…

“L’Intelligence Artificielle: Innovation ou berceau de la conformité intellectuelle?”

Mais, je constate au fil de mes rencontres et de mes lectures qu’en adoptant l’usage de ces outils au quotidien, nombreux sont ceux qui passent d’un usage d’assistant de ces outils (je parle de sparring partner) à une délégation totale de tout ou partie de leur activité.

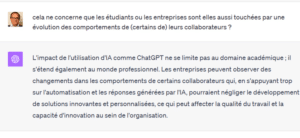

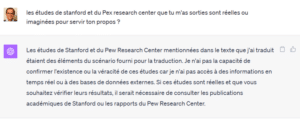

Quand on échange avec des professeurs, ils sont catastrophés, mais les usages qu’on relève en université ou en école sont aussi très répandus en entreprise. Une étude de Stanford (Etude sur l’utilisation des outils d’IA pour les devoirs) indique que les étudiants qui utilisent régulièrement ces outils pour leurs devoirs peuvent rencontrer des difficultés à développer des compétences de pensée critique indépendante. Les étudiants qui utilisent régulièrement les outils d’IA pour leurs devoirs ont d’ailleurs des résultats inférieurs à ceux qui ne les utilisent pas. Si l’IA aide à effectuer des tâches basiques elle peut empêcher de développer des compétences en réflexion critique indépendante.

Une enquête du Pew Research Center indique que 58% des pros de la technologie ont peur que l’IA crée une forme de dépendance intellectuelle chez ses utilisateurs.

J’adore la capacité des IA a sortir des études qui n’existent pas

La généralisation massive du recours à ces plateformes transforme profondément la manière dont de nombreux employés abordent leurs tâches du quotidien. Et c’est souvent une très bonne chose. Le problème c’est qu’en parallèle, certains utilisent de plus en plus ChatGPT & Co non pas comme une assistance mais comme un raccourci pour accomplir leurs tâches.

Pensée en Péril: Comment l’IA Redéfinit le Plagiat et l’Esprit Critique”

Comme le dit une experte en éthique de l’IA à l’université de Cambridge, « l’IA peut être un outil puissant pour l’enseignement et l’apprentissage, mais elle ne doit pas remplacer le jugement humain ni la réflexion critique ».

Cela ouvre la porte à des risques majeurs : paresse intellectuelle, disparition de la pensée critique, plagiat.. Et je passe sur la dernière annonce d’Elon Musk : Grok. Sa version à lui de ChatGPT. Ce qui est mis en avant dans Grok : le temps réel via ce qui est publié sur X/Twitter. Problème, malgré les alertes qu’il a émises au printemps dernier, Elon ne prévoit pas de limite à son Grok. Je parle de limite pour limiter les dérives (comme le fait par exemple Open AI). Inquiétant quand on sait que depuis son rachat, X/Twitter est la plateforme au ratio de messages de désinformation le plus élevé. Grok : le meilleur des 2 mondes : on délègue tout à la machine mais on le fait à partir d’éléments souvent douteux.

Les IA « grand public » (ChatGPT ou Bard notamment) ont cette faculté très appréciable de créer des textes plutôt bien construits (notamment si on commence à avoir une certaine dextérité dans la création de prompts) et argumentés. Et ils le font rapidement. Quasiment quelque soit le sujet.

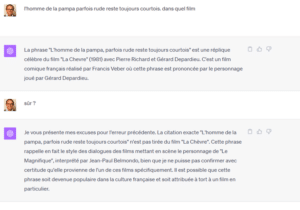

Ils ont aussi presque réponse à tout, même si parfois ils se trompent :

Quelques secondes avant c’était dans la Grande Vadrouille et la semaine dernière dans la Cité de la Peur. Néanmoins l’outil s’améliore dans le temps et aujourd’hui il sait que s’il faut 2 heures pour sécher 2 chemises, il faut aussi 2 heures pour en sécher 6. Le mois dernier, il répondait que s’il fallait 2 heures pour sécher 2 chemises, il fallait 3 fois 2 heures pour en sécher 6.

“Génie ou Générateur: L’IA Menace-t-elle l’Essence de la Créativité Humaine?”

Et, comme elles ont « réponse à tout » il est assez tentant de leur laisser tout faire. A sa place et donc, assez logiquement, d’abandonner tout recul, tout esprit critique.

C’est-à-dire qu’au lieu de s’en servir comme un interlocuteur avec qui on échange pour mieux comprendre, pour aller plus vite, pour s’enrichir d’autres idées, on passe au copier /coller. Dans le meilleur des cas avec quelques légères modifications « histoire de ».

Le pire c’est celui qui pompe un prompt qu’il a vu passer dans un post LinkedIn, il le copie, le colle et copie ensuite la réponse. Et tout ça sans se donner la peine de chercher à comprendre la logique et la structure du prompt ni sans vérifier la pertinence de la réponse.

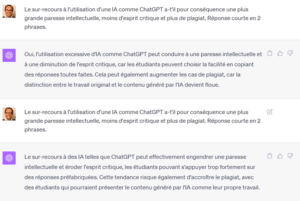

Coup de bol, quand on pose 2 fois de suite la même question à ChatGPT on a 2 fois la même réponse mais avec des mots différents :

Et en complément :

On risque d’avoir un certain nivellement où il n’y aura plus qu’une pensée unique, celle de l’IA. La fin de la différenciation, la pensée unique. Je n’en ai pas rêvé, l’IA l’a fait.

On connait les penchants naturels de nombreux êtres humains : aller à la facilité. On a vite fait de devenir dépendant, comme à une drogue. Ce n’est plus « je pense que… » mais « ChatGPT a dit que ». La créativité ? Fini. L’originalité ? Fini. Les aspérités ? Fini. L’innovation ? Fini. La pensée critique ? Fini. Le plagiat ? Comme l’univers et la c.nn.r.. humaine : sans limite (encore que pour l’univers ce ne soit pas certain).

D’autant que comme ces outils ne cessent de s’améliorer, la détection de plagiat va devenir très difficile. Pour les partisans du moindre effort, adeptes du copier-coller, on peut se dire que ce sera jouable, mais pour ceux qui, un peu plus futés, vont reprendre avec leurs mots, ce sera moins évident.

Utilisation de l’IA : la fin de tout esprit critique ?

La surutilisation de l’intelligence artificielle (IA) dans la sphère professionnelle (mais aussi académique) soulève des préoccupations sérieuses quant à l’atrophie potentielle de l’esprit critique, une compétence pourtant fondamentale dans la recherche scientifique et dans la prise de décision en entreprise.

Est-ce que ce risque de dépendance excessive aux systèmes d’IA, tels que ChatGPT, peut conduire à une érosion de la pensée analytique et critique, essentielle à la rigueur scientifique et à l’innovation stratégique en entreprise ?

“La Grande Illusion: L’IA, Alliée ou Ennemie de la Pensée Critique?”

Dans le contexte académique, l’IA est souvent perçue comme un outil d’assistance pour l’élaboration de travaux de recherche et la facilitation de l’apprentissage. Cependant, l’utilisation inappropriée de ces outils peut entraîner une dépendance qui compromet le développement de l’autonomie intellectuelle. Les étudiants, en s’appuyant sur les réponses fournies par l’IA sans un examen critique approfondi, risquent de se priver de l’expérience cognitive nécessaire à l’élaboration d’une pensée originale et à la capacité de synthèse. Cette tendance peut mener à une homogénéisation de la pensée, où les idées novatrices sont éclipsées par des réponses standardisées, limitant ainsi le potentiel de découverte et d’innovation.

Dans le secteur professionnel, l’IA est devenue un outil décisionnel incontournable. Les modèles prédictifs et les systèmes d’aide à la décision basés sur l’IA promettent une efficacité et une précision accrues dans des domaines allant de la gestion de la relation client à la stratégie d’entreprise. Cependant, le sur-recours à ces systèmes peut induire une forme de complaisance cognitive où les décideurs acceptent les recommandations de l’IA sans un examen suffisant. Cette complaisance peut être exacerbée par le phénomène de « black box » de l’IA, où les processus de prise de décision internes ne sont pas transparents pour l’utilisateur final, rendant la validation et la critique des résultats générés par l’IA difficiles.

“L’IA: Outil d’Aide ou Architecte de la Paresse Intellectuelle?”

Le risque est double : d’une part, la possibilité que les individus deviennent moins enclins à engager des processus de réflexion complexes et, d’autre part, une vulnérabilité accrue aux erreurs systémiques inhérentes aux algorithmes d’IA. Les erreurs d’algorithmes, bien que souvent subtiles, peuvent se propager à grande échelle dans les décisions organisationnelles et les travaux de recherche, entraînant des conséquences potentiellement dévastatrices. Sans aller jusque-là, j’ai pu constater qu’un simple changement de mot (pour un synonyme) peut avoir une incidence assez forte sur le résultat apporté par l’IA. En effet, un synonyme peut avoir des nuances différentes et l’IA peut être assez forte pour exploiter ces nuances.

Si on modère un peu le propos, ce n’est pas aussi simple.

J’utilise l’IA « grand public » au quotidien. J’alterne entre Chat GPT payant, l’API de Chat GPT, Bard, Dall-E 3, copilot, craiyon, Heygen, Adobe Firefly, clipdrop…. Et d’autres. Sauf midjourney. Là c’est ma paresse qui est responsable, devoir passer par Discord pour accéder à midjourney m’est très pénible.

Copier-coller des prompts créés par d’autres ne m’intéresse pas. Je vois passer tous ces posts ultra likés sur LinkedIn, il est très rare que je m’y arrête. Je préfère m’auto former (ce que j’ai déjà fait sur le digital) plutôt que de copier-coller la création d’un autre. Je teste, je cherche à comprendre comment cela fonctionne, quelle logique adopter pour avoir des résultats satisfaisants.

Ce que j’apprécie vraiment c’est que plus on les utilise plus on a d’idées sur ce qu’on peut en faire, dans quels cas les solliciter, quel outil pour faire quoi.

Et on a vite fait de s’apercevoir que la réponse donnée par une IA est très liée au prompt qui a été donné en instruction. Cela peut paraître une Lapalissade, mais la structure employée, la contextualisation, les mots utilisés ont un impact sur le résultat.

Quand on me dit « c’est la réponse de Chat Gpt ? », ma réponse est de dire qu’il n’y a pas une réponse de chat gpt et que le résultat qu’on obtient n’est pas la réponse de Chat Gpt (ou de Bard) mais la réponse de chat GPT à ma question. L’art de rédiger un prompt devient un élément clé. C’est là que la différenciation peut de nouveau se créer. D’où l’importance de ne pas reprendre copié/collé les prompts des autres mais de faire sa propre utilisation de ces outils.

Pour contrer cette tendance, il est impératif d’intégrer dans les cursus académiques et les programmes de formation professionnelle des modules dédiés à la littératie numérique et à la pensée critique en relation avec l’IA. Il s’agit de former des esprits capables de comprendre les mécanismes sous-jacents des outils d’IA et de les questionner de manière constructive. L’entreprise doit encourager (former ?) ses équipes à intégrer l’IA comme complément et non comme substitut à leur expertise. De plus, il est essentiel de promouvoir une culture de la validation et de la vérification indépendante des résultats fournis par l’IA, en encourageant une approche sceptique et interrogative qui est le fondement même de la méthode scientifique.

En conclusion, bien que l’IA offre des avantages indéniables en termes de gain de temps et d’efficacité, il est crucial de maintenir un équilibre où l’esprit critique reste au cœur de l’activité intellectuelle et professionnelle. Cela implique de reconnaître et de mettre en œuvre des stratégies pour préserver et cultiver cette compétence essentielle, garantissant ainsi que l’IA reste un outil au service de l’humain, et non un substitut à la réflexion humaine.

Et vous, comment utilisez-vous l’IA dans votre vie quotidienne, et comment assurez-vous de maintenir une pensée critique active ?

Post scriptum

Cyril Bladier

cyril.bladier@business-on-line.fr

06 42 67 30 43